Apache Hudi 統一批處理和近實時分析的存儲與服務解決方案

隨著大數據技術的發展,企業對數據處理的需求日益多樣化,既需要高效的批處理能力,也期望能夠實現低延遲的近實時分析。Apache Hudi(Hadoop Upserts Deletes and Incrementals)作為一種高效的數據湖存儲框架,通過其獨特的設計理念和功能,為批處理和近實時分析提供了統一的存儲與服務解決方案,并在信息處理和存儲支持服務領域發揮了重要作用。

一、Apache Hudi 的核心特性與統一存儲架構

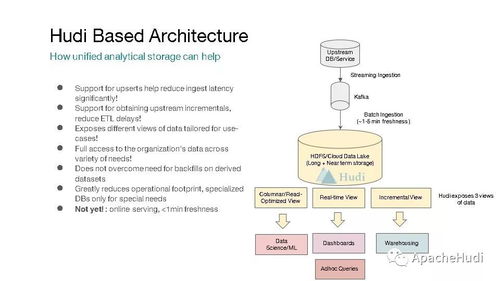

Apache Hudi 是一個開源的分布式數據存儲系統,構建在 Hadoop 生態系統之上,專注于支持數據的增量更新、刪除和增量查詢。其核心特性包括事務支持、快照隔離、數據版本管理以及自動壓縮機制。通過這些特性,Hudi 能夠實現數據的近實時攝取與處理,同時保持與批處理工作負載的兼容性。例如,Hudi 支持兩種表類型:Copy-on-Write(寫時復制)和Merge-on-Read(讀時合并)。Copy-on-Write 模式在寫入時直接更新數據文件,適用于頻繁查詢的場景;而 Merge-on-Read 模式則允許數據在寫入時暫存為增量日志,隨后在讀取時合并,從而優化寫入延遲,滿足近實時分析需求。這種靈活的架構使得 Hudi 能夠統一處理批量和流式數據,減少數據冗余和存儲成本。

二、批處理與近實時分析的一體化服務

在傳統大數據架構中,批處理和流處理往往采用不同的存儲系統,例如使用 HDFS 進行批處理,而 Kafka 或 Flink 處理實時流。這種分離導致數據孤島、管理復雜性和延遲問題。Apache Hudi 通過提供統一的服務層,解決了這些挑戰。它支持增量數據處理,允許用戶以微批或近實時的方式攝取數據,同時提供高效的查詢接口,如 Apache Spark、Presto 和 Hive 的集成。例如,企業可以利用 Hudi 的增量拉取功能,僅處理自上次批處理以來的新增數據,從而加速 ETL 流程;通過近實時數據攝取,Hudi 能夠在秒級延遲內提供最新數據,支持儀表板、風控和實時推薦等應用。這種一體化服務不僅簡化了數據管道,還提升了數據新鮮度和處理效率。

三、信息處理和存儲支持服務的應用優勢

Apache Hudi 在信息處理和存儲支持服務方面具備顯著優勢。它提供了事務性保證,確保數據的一致性和可靠性,這在金融和電商等關鍵領域尤為重要。Hudi 的數據版本控制和快照功能,使得用戶可以回溯歷史數據狀態,支持審計和合規需求。Hudi 的自動數據管理功能,如文件大小優化和清理舊版本,降低了運維負擔。在實際應用中,許多組織已采用 Hudi 來構建數據湖,例如在 Uber 的出行數據平臺中,Hudi 幫助實現了大規模數據的近實時更新和分析,顯著提升了業務響應速度。通過整合批處理和近實時分析,Hudi 不僅優化了存儲資源,還提供了靈活的數據處理能力,支持從離線報表到實時監控的全方位信息服務。

Apache Hudi 通過其創新的存儲架構和統一的服務模式,成功彌合了批處理與近實時分析之間的鴻溝。它不僅提高了數據處理效率,還強化了信息處理和存儲支持服務的可靠性與可擴展性。隨著企業對實時洞察需求的增長,Hudi 有望在數據湖生態中扮演更重要的角色,推動大數據技術的進一步發展。

如若轉載,請注明出處:http://www.hicom.net.cn/product/5.html

更新時間:2026-02-24 02:41:51